딥러닝 학습 개요

Weight Init > Forward Pass > Compute Loss > Optimization > Weight Update

위 과정을 만족스러운 loss 값이 나올 때까지 반복한다.

가중치 업데이트 과정

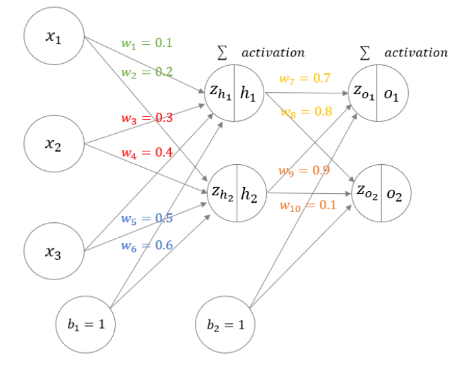

순전파 (Forward Pass)

- 입력과 가중치를 곱하여 모두 합한 값을 은닉층으로 넘겨줌

- ex)

- 활성화 함수를 적용

- ex)

- 이때 활성화 함수는 보통 비선형 함수로 정의함

- Sigmoid, ReLU

- output layer에 도달하면 softmax 함수를 통해 출력 점수를 0 ~ 1 사이로 정규화하여 나타냄

- 도출된 예측값과 실제값을 비교하여 Loss(error) 값 구함

- Loss 값을 토대로 가중치를 갱신(optimizer)

행렬곱으로 보는 순전파

참고

Prev: 1. 딥러닝 개요

Next: 3. 활성화 함수(Activaion Function)